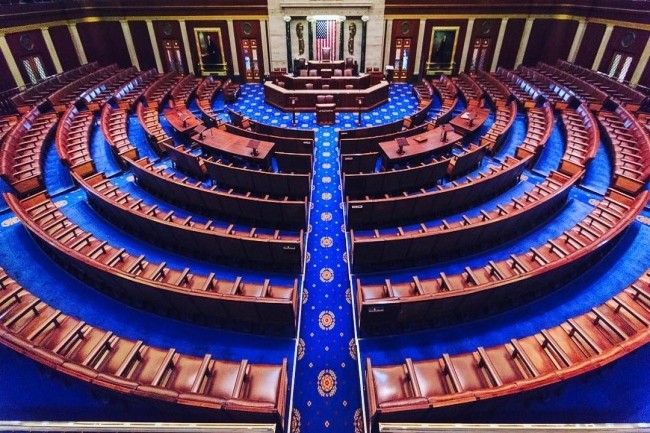

Si l’administration Trump essaye patiemment de torpiller la mise en pratique de l’IA Act en Europe, elle veut aussi réduire à néant toute forme de régulation sur le sujet aux Etats-Unis. Et c’est par la voie parlementaire que la salve est partie. Des élus Républicains du Congrès ont proposé d’interdire toute réglementation sur l’IA pour les dix prochaines années. Le texte a été discrètement inséré dans le projet de loi budgétaire.

Une vide juridique problématique

Ce moratoire général s’il est voté empêcherait la plupart des gouvernements des États et des collectivités locales d'appliquer la réglementation de l'IA jusqu'en 2035. Le projet de loi stipule qu'« aucun État ni aucune subdivision politique de celui-ci ne peut appliquer une loi ou un règlement régissant les modèles d'intelligence artificielle, les systèmes d'intelligence artificielle ou les systèmes de décision automatisés » pendant 10 ans.

Cette proposition inquiète les experts du secteur en alertant sur le vide juridique. « Le moratoire proposé, d’une durée de dix ans, sur la réglementation de l’IA au niveau des États est une arme à double tranchant », a déclaré Abhivyakti Sengar, directrice de pratique au cabinet d’analyte Everest Group. « D’une part, il vise à prévenir un environnement réglementaire fragmenté susceptible de freiner l’innovation ; d’autre part, il risque de créer un vide réglementaire, laissant les décisions cruciales concernant la gouvernance de l’IA entre les mains d’entités privées sans surveillance suffisante.»

Des exceptions, mais aussi une pression sur les Etats

La législation prévoit des exceptions spécifiques. Selon le texte, les États seraient toujours autorisés à appliquer des lois dont « l’objectif et l’effet principaux sont de supprimer les obstacles juridiques au déploiement ou à l’exploitation d’un modèle d’intelligence artificielle, d’un système d’intelligence artificielle ou d’un système de décision automatisé, ou de faciliter leur déploiement ou leur exploitation ». Les États pourraient également appliquer des lois simplifiant les « procédures d’octroi de licences, de permis, de routage, de zonage, d’approvisionnement ou de déclaration » pour les systèmes d’IA.

Nonobstant, le projet de loi interdit explicitement aux États d'imposer « toute exigence substantielle en matière de conception, de performance, de traitement des données, de documentation, de responsabilité civile, de fiscalité, de frais ou autre » spécifiquement à l'IA. Cette limitation empêcherait les États de créer des cadres de surveillance dédiés à l'IA. Le moratoire menace particulièrement les lois sur la protection des données personnelles des États. Sans ces lois, les consommateurs ont peu de garanties quant à la manière dont les systèmes d'IA utilisent leurs données, obtiennent leur consentement ou prennent des décisions qui les concernent. Les différentes initiatives des États visant à réglementer les systèmes d'IA – des exigences de transparence algorithmique à la protection de la confidentialité des données pour l'entraînement de l'IA – pourraient être neutralisées sans débat ni consultation publique.

Un fossé réglementaire avec l’UE

L'approche américaine contraste désormais fortement avec la législation sur l'IA de l'Union européenne, qui impose des exigences strictes aux systèmes d'IA à haut risque. « Alors que les États-Unis s'écartent du cadre réglementaire strict de l'UE en matière d'IA, les multinationales pourraient être confrontées à la difficulté de naviguer entre des normes contradictoires », a noté Abhivyakti Sengar. Cette divergence pourrait entraîner une augmentation des coûts de conformité et des complexités opérationnelles. Un avis partagé par Sanchit Vir Gogia, analyste en chef et CEO de Greyhound Research, « le moratoire américain accentuera probablement les divergences réglementaires avec l'Europe ». Il ajoute, « cela accélérera la fragmentation de la conception mondiale des produits d'IA, où l'éligibilité des cas d'usage et les seuils éthiques varient considérablement selon les régions. »

Pour les entreprises, elles n’ont pas attendu les directives gouvernementales. « Avant même que la surveillance publique ne soit suspendue, elles ont déjà mis en place des conseils internes de gouvernance de l'IA », a expliqué Sanchit Vir Gogia. « Ces régimes internes sont dirigés par les RSSI, les équipes juridiques et les équipes de gestion des risques ». Mais le consultant rappelle qu’un moratoire ne signifie pas absence de responsabilité. « les entreprises restent juridiquement responsables. Je pense que l'absence de lois spécifiques n'élimine pas les risques juridiques ; elle ne fait que déplacer le champ de bataille des bureaux de conformité aux tribunaux. »

Commentaire